Associative Memory

Associative Memory 連想記憶の双曲数化(3)

プロジェクションルール前回、双曲連想記憶の安定性条件 \( w_{ab}=w_{ba},\, u_{aa} \geq | v_{aa} | \) を与えました。実数や複素数の場合と同じように進めますが、安定性条件が異なるので若干の注意が必要...

Associative Memory

Associative Memory  Associative Memory

Associative Memory  Associative Memory

Associative Memory  Associative Memory

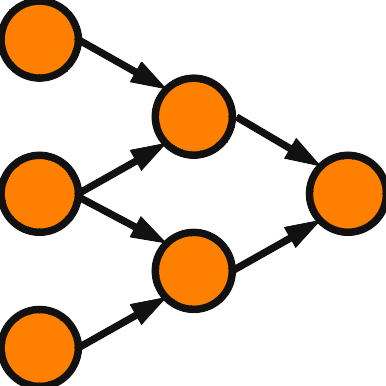

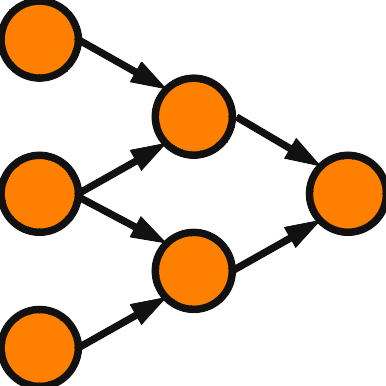

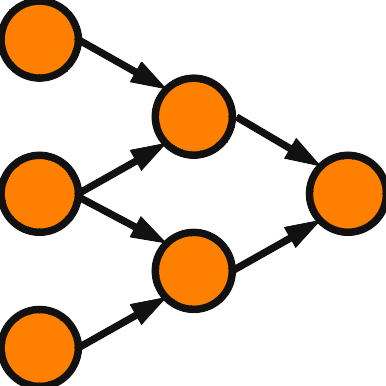

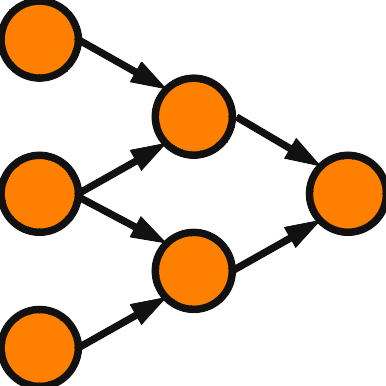

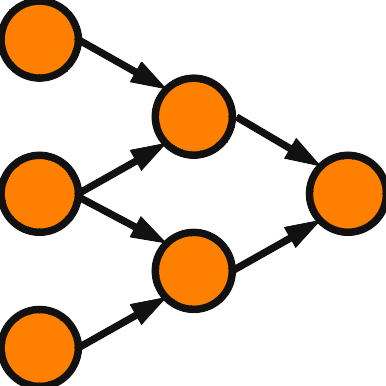

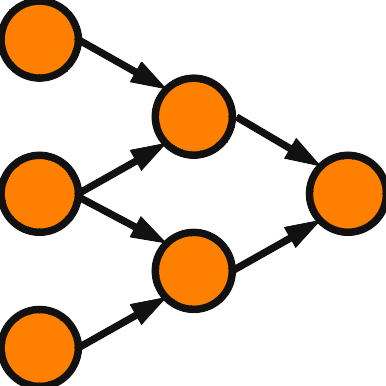

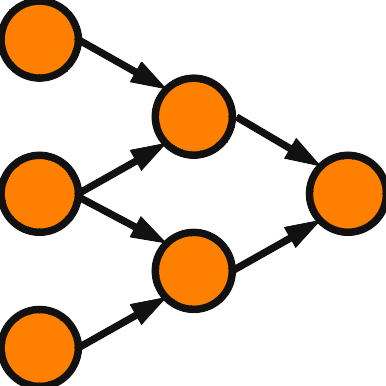

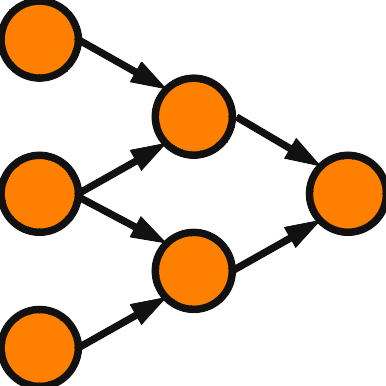

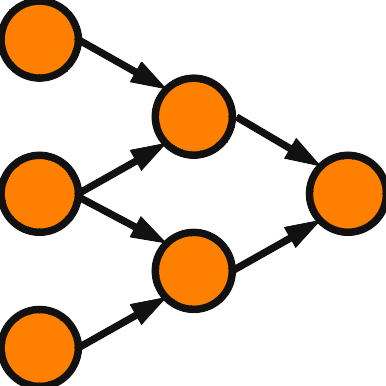

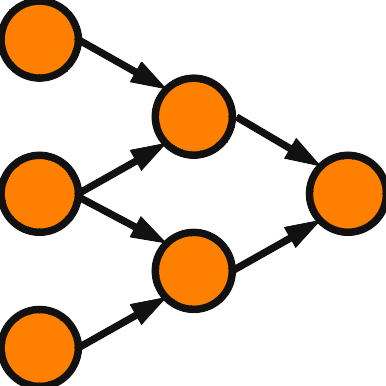

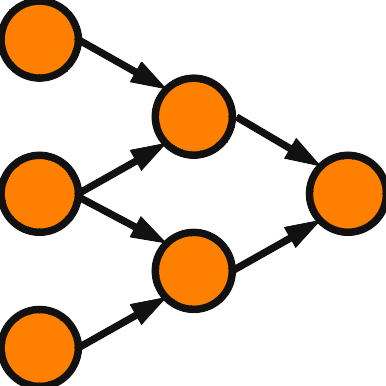

Associative Memory  MLP

MLP  Associative Memory

Associative Memory  Associative Memory

Associative Memory  Associative Memory

Associative Memory  Associative Memory

Associative Memory  Associative Memory

Associative Memory